สรุปข่าว AI: Apple ประกาศสงคราม Slop, LiteLLM ถูกแฮก Supply Chain, Sora ปิดตัว, Figma เปิด MCP

Apple ประกาศสงคราม "War on Slop" — App Store เผชิญวิกฤตแอปขยะจาก Vibe Coding

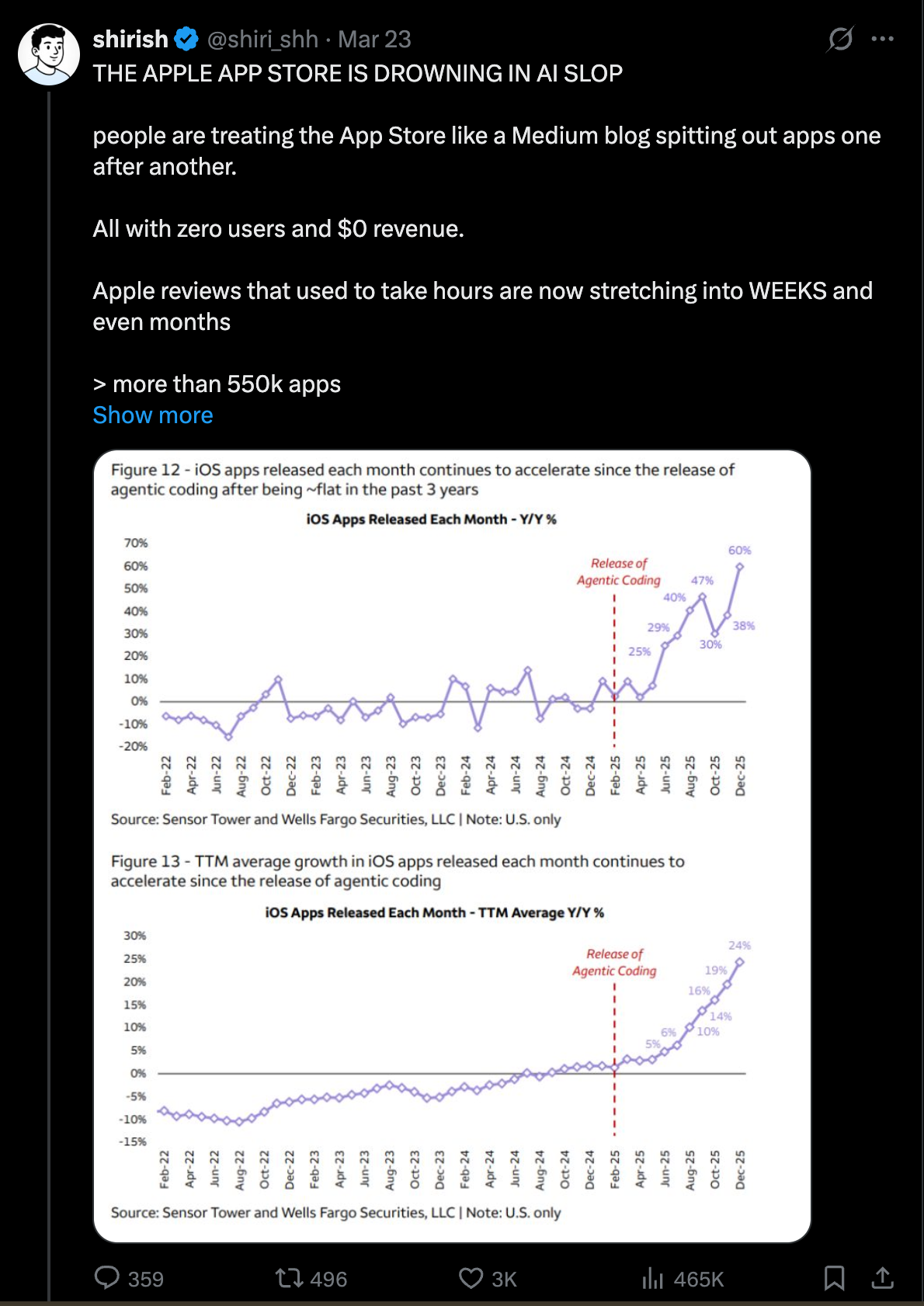

หนึ่งในประเด็นที่ร้อนแรงที่สุดของวงการเทคโนโลยีในช่วงสัปดาห์ที่ผ่านมาคือสถานการณ์ที่ Apple App Store กำลังถูกท่วมท้นด้วยแอปพลิเคชันคุณภาพต่ำที่สร้างขึ้นจากเครื่องมือ AI แบบที่เรียกกันว่า vibe coding ข้อมูลจากกราฟแสดงจำนวนแอปที่ส่งเข้ามารีวิวพุ่งสูงขึ้นอย่างผิดปกติ สะท้อนให้เห็นว่าใครก็ตามที่มีเครื่องมือ AI สามารถสร้างแอปได้ภายในเวลาไม่กี่ชั่วโมง โดยไม่จำเป็นต้องมีความรู้ด้านการเขียนโปรแกรมเชิงลึกแต่อย่างใด

Apple ตอบโต้ด้วยการ บล็อกแอปที่สร้างจากแพลตฟอร์มอย่าง Replit และ Vibecode โดยอ้างเหตุผลด้านนโยบาย กระบวนการรีวิวแอปแบบดั้งเดิมที่ Apple ใช้มานานหลายทศวรรษกำลังถูกท้าทายอย่างหนัก เมื่อปริมาณแอปที่ส่งเข้ามาเพิ่มขึ้นแบบทวีคูณแต่คุณภาพกลับลดลงอย่างมาก คำว่า "War on Slop" กลายเป็นธีมหลักของปี 2569 ที่สะท้อนถึงการต่อสู้ระหว่างแพลตฟอร์มกับเนื้อหาคุณภาพต่ำที่ผลิตด้วย AI

สิ่งที่น่าสนใจคือปรากฏการณ์นี้ไม่ได้จำกัดอยู่แค่แอปขยะเท่านั้น มีกรณีที่นักพัฒนาอายุเพียง 18 ปี ที่ไม่ได้เรียนจบมหาวิทยาลัย สามารถสร้างแอปที่มีมูลค่าถึง 100 ล้านดอลลาร์ได้ด้วยเครื่องมือ vibe coding ปรากฏการณ์นี้กำลังทำลายรูปแบบการกระจายแอปพลิเคชันที่ดำเนินมายาวนาน และคุกคามอำนาจเหนือตลาดของ Apple App Store ที่ครองมานับตั้งแต่ยุค iPhone รุ่นแรก คำถามสำคัญคือ Apple จะปรับกลยุทธ์อย่างไรเมื่อกำแพงที่เคยกั้นระหว่างนักพัฒนามืออาชีพกับคนทั่วไปถูกรื้อทิ้งลงอย่างสิ้นเชิง

Anthropic เปิดเผยสถาปัตยกรรม Multi-Agent Harness สำหรับงาน Frontend และ Long-Running Tasks

Anthropic เผยแพร่เอกสารเชิงเทคนิคเกี่ยวกับระบบ multi-agent harness ที่ออกแบบมาสำหรับงานออกแบบ frontend และงานซอฟต์แวร์ที่ใช้เวลานาน หัวใจสำคัญของแนวทางนี้คือการเน้น orchestration หรือการประสานงานระหว่าง agent หลายตัว มากกว่าการใช้ one-shot prompting ที่สั่งงานครั้งเดียวแล้วหวังผลลัพธ์ที่สมบูรณ์

ความสามารถ "computer use" ของ Anthropic เปิดให้โมเดล AI ทำงานในสภาพแวดล้อมซอฟต์แวร์จริงที่ซับซ้อนและไม่มี API ที่เชื่อถือได้ แต่ก็ยอมรับว่ายังช้าและอยู่ในช่วงเปลี่ยนผ่าน จนกว่าเครื่องมือต่าง ๆ จะเปิด API หรือ CLI ให้ agent เข้าถึงได้โดยตรงมากขึ้น ปัญหาคอขวดในเชิงปฏิบัติการยังคงมีอยู่หลายจุด ไม่ว่าจะเป็นกลไกการ retry เมื่อทำงานผิดพลาด การ rollback กลับสู่สถานะก่อนหน้า ระบบ webhook สำหรับแจ้งเตือน structured logging ที่ช่วยให้ debug ได้ง่าย และ recovery paths สำหรับกรณีที่ระบบล้มเหลวระหว่างทาง

Figma เปิดตัว MCP Server — เปลี่ยน Design Canvas ให้ AI แก้ไขได้โดยตรง

Figma ประกาศเปิดตัว MCP server พร้อมความสามารถในการแก้ไข canvas โดย AI โดยตรง ในรูปแบบ open beta ถือเป็นตัวอย่างที่ชัดเจนที่สุดของแนวคิด tool-calling becoming product-native ที่ความสามารถในการเรียกใช้เครื่องมือของ AI ถูกฝังลงไปในตัวผลิตภัณฑ์โดยตรง ไม่ใช่แค่เป็น plugin หรือ add-on ภายนอก

สิ่งที่น่าตื่นเต้นคือ GitHub Copilot CLI สามารถทำงานผ่าน MCP ได้แล้ว และเครื่องมืออย่าง Cursor สามารถสร้าง component และหน้า frontend ใน Figma ได้โดยใช้ design system ของทีมเป็นฐาน หมายความว่านักพัฒนาสามารถสั่งให้ AI สร้างหน้าจอใหม่ใน Figma ที่สอดคล้องกับ design system ที่มีอยู่แล้ว ลดขั้นตอนการทำงานระหว่างนักออกแบบและนักพัฒนาลงอย่างมาก

ในทิศทางเดียวกัน LangChain ก็ผลักดัน Slack-native Fleet workflows ที่มาพร้อม custom bot และระบบ Inbox สำหรับ human approval ช่วยให้ทีมสามารถตรวจสอบและอนุมัติการทำงานของ AI agent ได้ภายใน Slack โดยตรง

Hermes Agent v0.4.0 — Personal Agent Runtime ที่พัฒนาตัวเองได้

Nous Research ปล่อย Hermes Agent v0.4.0 ซึ่งเป็นการอัปเดตครั้งใหญ่ที่รวม pull request กว่า 300 รายการภายในสัปดาห์เดียว ระบบนี้รองรับ OpenAI-compatible Responses API เป็น backend ทำให้สามารถใช้งานจากไคลเอนต์ที่รองรับ OpenAI API ได้ทันที ไม่ว่าจะเป็น Open WebUI, LobeChat หรือแอปพลิเคชันอื่น ๆ

จุดเด่นที่แตกต่างจาก agent framework ทั่วไปคือระบบ background self-improvement loops ที่ agent สามารถปรับปรุงตัวเองได้อย่างต่อเนื่อง โดยมี post-response review agent คอยตรวจสอบหลังการตอบทุกครั้ง แล้วตัดสินใจว่าข้อมูลหรือทักษะใดควรจดจำไว้เป็น reusable memory หรือ skill สำหรับใช้ในอนาคต กลไกนี้ทำให้ agent ฉลาดขึ้นตามการใช้งาน ไม่ใช่แค่ทำงานตามคำสั่งซ้ำ ๆ

นอกจากนี้ยังมีฟีเจอร์ context compression ที่ช่วยบีบอัดบริบทให้ agent สามารถทำงานกับข้อมูลจำนวนมากได้โดยไม่เกินขีดจำกัดของ token window พร้อมปรับปรุง CLI ergonomics ให้ใช้งานสะดวกขึ้น

AI2 MolmoWeb — Browser Agent โอเพนซอร์สที่เอาชนะระบบปิดได้

AI2 (Allen Institute for AI) เปิดตัว MolmoWeb ซึ่งเป็น browser agent ที่สร้างบนโมเดล Molmo 2 มีให้เลือกทั้งขนาด 4B และ 8B พารามิเตอร์ ความน่าสนใจอยู่ที่ประสิทธิภาพ — MolmoWeb เป็น open-weight model ที่ทำคะแนนสูงสุดใน 4 web-agent benchmark ที่ใช้วัดกันในวงการ เอาชนะ agent จากบริษัทที่ใช้โมเดลปิดบางรายได้

OpenReward — แพลตฟอร์ม Reinforcement Learning กว่า 330 สภาพแวดล้อม

GenReasoning เปิดตัว OpenReward แพลตฟอร์มที่รวบรวมสภาพแวดล้อมสำหรับ reinforcement learning (RL) มากกว่า 330 แบบ พร้อมระบบ autoscaled compute ที่ปรับขนาดทรัพยากรคำนวณโดยอัตโนมัติ สิ่งที่น่าทึ่งคือผ่าน API เดียวสามารถเข้าถึงงาน RL ที่ไม่ซ้ำกันมากกว่า 4.5 ล้านงาน

vLLM อัปเดตใหญ่จาก GTC — ประสิทธิภาพ Multimodal พุ่ง 2.5 เท่า

vLLM ประกาศอัปเดตสำคัญหลายรายการในงาน GTC โดยเวอร์ชันใหม่มาพร้อม Model Runner V2 ที่ใช้ GPU-native Triton kernels พร้อม hybrid memory allocator ตัวเลขที่โดดเด่นที่สุดคือ P99 throughput สำหรับงาน multimodal เพิ่มขึ้น 2.5 เท่า นอกจากนี้ Hugging Face Transformers สามารถทำ throughput ได้ถึง 95% ของ vLLM สำหรับการ generate ขนาด 8K token แล้ว

hf-mount — เมาท์ Hugging Face เป็น Local Filesystem สำหรับ Agent

เครื่องมือใหม่ชื่อ hf-mount เปิดให้สามารถ mount dataset, model และ storage จาก Hugging Face มาเป็น local filesystem ได้โดยตรง ตัวอย่างที่ยกมาคือการ mount ข้อมูล FineWeb ขนาด 5TB มาใช้งานเหมือนไฟล์ในเครื่อง โดยไม่ต้องดาวน์โหลดทั้งหมดก่อน เนื่องจาก agent ส่วนใหญ่ทำงานกับ filesystem ได้ดีอยู่แล้ว การ mount เป็น filesystem จึงเหมาะสำหรับ agent memory, scratchpad และ team artifact

TurboQuant จาก Google Research — บีบ KV-Cache ลด Memory 6 เท่า

Google Research เผยแพร่งานวิจัย TurboQuant ที่เน้นการบีบอัด KV-cache ผลลัพธ์ — ลด memory ลง 6 เท่า และเร่งความเร็วได้สูงสุด 8 เท่า โดยไม่สูญเสียความแม่นยำ ยิ่ง context ยาว KV-cache ก็ยิ่งใหญ่ การลด memory จึงมีผลกระทบโดยตรงต่อต้นทุนการให้บริการ LLM

LiteLLM ถูกแฮก Supply Chain — ขโมยรหัสผ่าน Cloud ทุกประเภท

เหตุการณ์ด้านความปลอดภัยที่ร้ายแรงที่สุดในสัปดาห์นี้คือการโจมตี supply chain ต่อ LiteLLM เวอร์ชัน v1.82.7 และ v1.82.8 บน PyPI ถูกฝังโค้ดอันตราย

วิธีการโจมตีมีความซับซ้อนสูง โดยใช้เทคนิค .pth file ที่จะทำงานอัตโนมัติทุกครั้งที่ Python interpreter เริ่มต้น โค้ดอันตรายนี้ถูกออกแบบมาเพื่อ ขโมยข้อมูลสำคัญทุกประเภท ได้แก่:

- Cloud credentials (AWS, GCP, Azure)

- SSH keys สำหรับเข้าถึงเซิร์ฟเวอร์

- Kubernetes configs สำหรับจัดการ container cluster

- CI/CD secrets ที่ใช้ใน pipeline การ deploy

- Crypto wallets

- Shell history ที่อาจมีรหัสผ่านหลุดอยู่

สาเหตุคือ บัญชี GitHub ของ CEO ถูกแฮก ที่น่าตกใจยิ่งกว่าคือหากเครื่องมี timezone เป็น Asia/Tehran จะรัน rm -rf / ลบข้อมูลทั้งหมด ผลกระทบยังลามไปถึง DSPy แบบ transitive สำหรับ Aider ยังปลอดภัยเนื่องจากใช้ v1.82.3 ปัจจุบัน package ถูก quarantine บน PyPI แล้ว

การออกแบบ Permission สำหรับ Agent Tools — "De-vibing" เพื่อความปลอดภัย

เหตุการณ์ LiteLLM จุดประกายการถกเถียงเรื่อง permission design สำหรับ AI agent tools ประเด็นหลักคือเครื่องมือ coding ที่ใช้ AI ต้องการค่าเริ่มต้นด้านสิทธิ์ที่เข้มงวดกว่าที่เป็นอยู่ ตัวอย่างคือ auto mode ของ Claude Code ที่ยังเป็นที่ถกเถียง ในโลกที่ AI agent ทำงานบนเครื่อง filesystem ทั้งหมดกลายเป็นพื้นผิวโจมตี แนวคิด "de-vibing" สะท้อนว่าการเขียนโค้ดด้วย AI แบบไม่ตรวจสอบสร้างความเสี่ยงร้ายแรง

Microsoft ดึงผู้นำ AI2 เข้าทีม Superintelligence — โอเพนซอร์สเสียแรง

Microsoft ดึงตัวผู้นำระดับสูงจาก AI2 ได้แก่ Ali Farhadi, Hanna Hajishirzi และ Ranjay Krishna เข้าร่วมทีม Microsoft Superintelligence สร้างความกังวลอย่างมากเกี่ยวกับ อนาคตของสถาบันวิจัยเปิดเมื่อเทียบกับ hyperscaler ที่มีทรัพยากรมหาศาล

OpenAI ปิด Sora, ตั้ง Foundation 1 พันล้านดอลลาร์ และ LLM ใหม่ชื่อ "Spud"

Sora กำลังจะปิดตัวลง เป็น "เหยื่อรายแรกของ Side Quest massacre" ที่ OpenAI ตัดผลิตภัณฑ์ที่ไม่ใช่แกนหลักออก สาเหตุหลักจากต้นทุนสูง ผู้ใช้น้อย และปัญหาลิขสิทธิ์ ในขณะเดียวกัน OpenAI Foundation วางแผนใช้เงินมากกว่า 1 พันล้านดอลลาร์ในปีหน้า โดยมี Wojciech Zaremba นำด้าน AI resilience ส่วน LLM รุ่นถัดไปชื่อรหัส "Spud" ผ่านการพัฒนาเบื้องต้นแล้ว

LM Studio แจ้งเตือนมัลแวร์ — ยืนยันเป็น False Positive

ผู้ใช้ LM Studio จำนวนมากตกใจเมื่อ Windows Defender แจ้งเตือนว่าพบ Trojan:JS/GlassWorm.ZZ!MTB แต่ทั้ง LM Studio และ Microsoft ยืนยันเป็น false positive สาเหตุคือ Electron bundle ที่ถูก obfuscate ทำให้ heuristic ของ Defender มองว่าคล้ายมัลแวร์ เหตุการณ์นี้สะท้อนบรรยากาศหวาดระแวงเรื่องความปลอดภัยของซอฟต์แวร์ AI

Fox — Inference Engine ตัวใหม่เขียนด้วย Rust แทน Ollama ได้ทันที

โปรเจกต์ Fox เป็น LLM inference engine เขียนด้วย Rust ออกแบบเป็น drop-in replacement สำหรับ Ollama ตัวเลขประสิทธิภาพ — throughput สูงกว่า 2 เท่า และ TTFT ลดลง 72% ด้วยเทคนิค PagedAttention, continuous batching และ prefix caching รองรับทั้ง CUDA, Vulkan, Metal และ CPU

RYS II — การค้นพบ "ภาษาสากล" ในชั้นกลางของ LLM

งานวิจัย RYS II ทดลองกับ Qwen3.5 27B พบว่าในชั้น transformer กลาง ๆ ภาษาจีนและอังกฤษมี latent representation ที่คล้ายกัน โมเดลดูเหมือนแปลงเป็น "ภาษาภายใน" ที่เป็นสากล นอกจากนี้ การทำซ้ำ transformer block ในชั้นกลางช่วยเพิ่มประสิทธิภาพ เปิดทางสู่วิธีการใหม่ในการปรับแต่งโมเดลสำหรับงานหลายภาษา

FlashAttention-4 — เร็วขึ้น 2.7 เท่า เขียนด้วย Python แทน C++

FlashAttention-4 ทำ 1,613 TFLOPs/s บน NVIDIA B200 (71% peak) เร็วกว่า Triton ถึง 2.1-2.7 เท่า สิ่งที่สร้างความประหลาดใจคือ เขียนด้วย Python ผ่าน CuTeDSL ไม่ใช่ C++ เวลา compile ลดจาก 55 วินาทีเหลือ 2.5 วินาที แต่ รองรับเฉพาะ Hopper และ Blackwell (H100/B200) มีประเด็นที่ NVIDIA โปรโมต RTX 6000 Pro ว่าเป็น "Blackwell" แต่ ไม่รองรับ FA4

SillyTavern NPC Extension — สร้าง NPC มีชีวิตในทุกเกม

SillyTavern เปิดตัว NPC Extension ใช้ Cydonia เป็นโมเดล roleplay และ Qwen 3.5 0.8B เป็น game master รองรับ voice cloning จากไฟล์เสียงในเกม ทั้งหมดทำงาน local ไม่ต้องส่ง cloud เป็นตัวอย่างว่าโมเดลขนาดเล็กสร้างประสบการณ์ที่น่าทึ่งได้

จีนรุกหนัก Open-Source AI — สหรัฐฯ เตือนคุกคามความเป็นผู้นำ

หน่วยงานที่ปรึกษาสหรัฐฯ เตือนว่า กลยุทธ์ open-source AI ของจีนคุกคามตำแหน่งผู้นำ ตัวเลขน่าสนใจ — อัตราการยอมรับ AI ในจีน 87% เทียบกับ 32% ในสหรัฐฯ ตัวอย่างรูปธรรมคือ Kimi K2.5 จากจีนถูก Cursor นำไปใช้ แสดงว่าโมเดลจีนแทรกซึมเข้าเครื่องมือหลักของนักพัฒนาตะวันตกแล้ว

Jensen Huang และ Gubrud ประกาศ AGI บรรลุแล้ว — แต่นิยามยังไม่ตรงกัน

Mark Gubrud ผู้ที่ได้รับเครดิตว่าบัญญัติคำว่า AGI และ Jensen Huang CEO ของ NVIDIA ต่างประกาศว่า AGI บรรลุแล้ว แต่ปัญหาพื้นฐานคือ ยังไม่มีนิยาม AGI ที่เป็นสากล สิ่งที่ชัดเจนคือเส้นแบ่งระหว่าง "narrow AI" กับ "general AI" เริ่มเลือนลางลงทุกที

Claude Code /dream — ระบบ "หลับฝัน" สำหรับจัดการความทรงจำ AI

Claude Code เพิ่มฟีเจอร์ /dream เปรียบเสมือน "REM sleep" ทำงานใน 4 เฟส: Orient (ทำความเข้าใจสถานะ), Gather signal (รวบรวมข้อมูลสำคัญ), Consolidate (จัดระเบียบความทรงจำ), Prune & index (ตัดสิ่งไม่จำเป็น) ระบบ trigger หลัง 24+ ชั่วโมงและ 5+ เซสชัน ทำงาน read-only กับโค้ด แก้ไขเฉพาะ memory files

Moreau — GPU-Native Solver จากทีม CVXPY ที่เร็วขึ้นหลายลำดับขนาด

ทีม CVXPY เปิดตัว Moreau solver ที่ออกแบบตั้งแต่ต้นเพื่อทำงานบน GPU โดยตรง ผลลัพธ์คือ ความเร็วเพิ่มขึ้นหลายลำดับขนาด เมื่อเทียบกับ solver แบบ CPU สำคัญสำหรับงาน AI ที่ต้องแก้ optimization เป็นส่วนหนึ่งของ pipeline ไม่ว่าจะเป็นการฝึกโมเดล portfolio optimization หรือ robotics

แนวโน้มสำคัญจากข่าวสัปดาห์นี้

ภาพรวมชี้ให้เห็น 3 แนวโน้มสำคัญ ประการแรก ความปลอดภัยของ AI supply chain กลายเป็นวิกฤต เหตุการณ์ LiteLLM แสดงว่าแม้แค่ไลบรารีเดียวที่ถูกโจมตีก็กระทบระบบนับไม่ถ้วน ประการที่สอง เครื่องมือ AI กำลังเปลี่ยนจาก "ใช้แยก" เป็น "ฝังในผลิตภัณฑ์" Figma เปิด MCP, LangChain ฝัง agent ใน Slack, hf-mount เปลี่ยน Hugging Face เป็น filesystem ประการที่สาม ประสิทธิภาพ inference ก้าวกระโดด FlashAttention-4, TurboQuant, Fox และ vLLM ล้วนลดต้นทุนการรัน AI อย่างรวดเร็ว

การแข่งขันสหรัฐฯ-จีนยังคงร้อนแรง จีนใช้ open-source เป็นหัวหอก ขณะที่สถาบันวิจัยเปิดในสหรัฐฯ สูญเสียบุคลากรให้บริษัทยักษ์ใหญ่ สร้างความย้อนแย้ง — สหรัฐฯ กังวล open-source จากจีน แต่ ecosystem ของ open-source AI ในสหรัฐฯ เองก็กำลังถูกดูดซับเข้าบริษัทเอกชน

ข้อมูล ณ วันที่ 25 มีนาคม 2569 — บทความนี้จัดทำขึ้นเพื่อให้ข้อมูลเท่านั้น ไม่ได้เป็นคำแนะนำด้านการลงทุนแต่อย่างใด